Как создавать видео в нейросетях бесплатно на своем компьютере

Опубликовано: 19.12.2025 · 1 мин чтения

Занять режиссерское кресло в 2025 году может каждый, у кого есть мощная видеокарта или стабильный интернет. Всё больше людей из простых зрителей превращаются в креаторы. Если раньше CGI-графика требовала студии с сотней сотрудников, то сегодня создание ролика нейросеть берет на себя. Однако перед энтузиастом встает вопрос: использовать облачные сервисы, где вы платите кредитами (и своими данными), или развернуть локальную студию? В этом гайде мы разберем всё: от сборки «железа» под домашний Голливуд до обзора лучших инструментов, и ответим на главный вопрос — как создавать видео в нейросети эффективно и бесплатно.

Какие сценарии генерации видео бывают

Прежде чем нажимать кнопку «Generate», определитесь с задачей. Современные модели работают по нескольким основным сценариям (пайплайнам):

Text-to-Video (текст в видео)

Вы пишете текстовый промт (сценарий), а модель генерирует последовательность кадров с нуля. Это идеальный вариант для быстрых прототипов или сюрреалистичных сцен, где нет исходников.

Image-to-Video (Картинка + Текст в видео)

Самый популярный сценарий для контроля качества. Вы берете картинку видео делает на её основе. То есть, загружаете стартовый кадр (сгенерированный в Midjourney или Flux), и просите нейросеть «оживить» его: добавить движение камеры, порыв ветра или моргание персонажа.

Video-to-Video (Видео в видео)

Стилизация. Вы загружаете исходный ролик (например, снятый на телефон), и нейросеть перерисовывает его в стиле аниме, киберпанка или пластилина, сохраняя исходную динамику.

Inpainting/Outpainting

Дорисовка фона или изменение части кадра внутри видеоряда.

Interpolation

Генерация промежуточных кадров между начальной и конечной точкой. Вы даете старт и финиш, а нейросеть видео склеивает, просчитывая путь.

Лучшие приложения для созданий видео

Мы разделили софт на две лиги: «Тяжелая артиллерия» (локальный запуск на вашем ПК для полного контроля и безлимита) и «Облачные сервисы» (для тех, кто хочет быстро и без настройки).

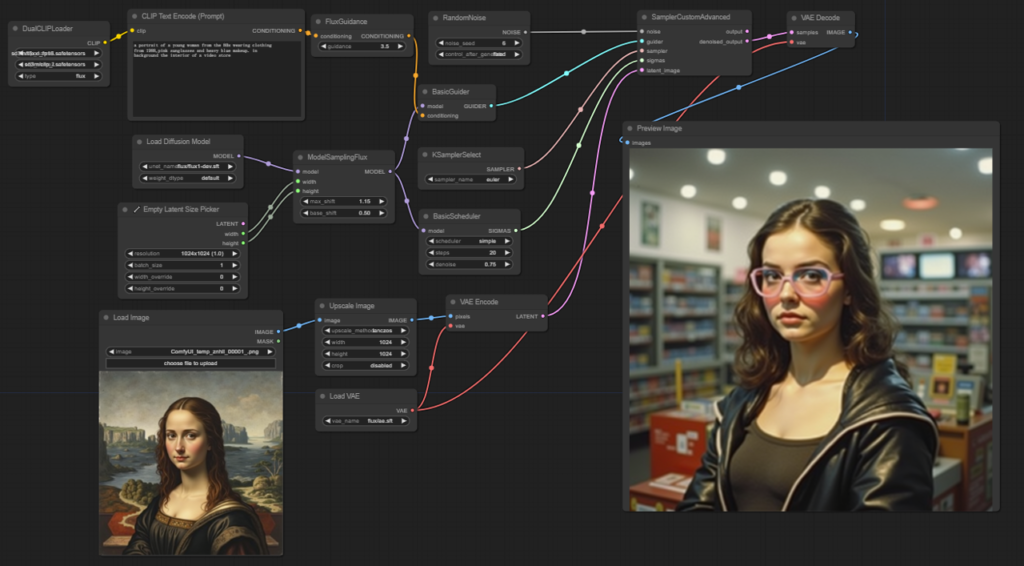

Приложение 1: ComfyUI (Локально) — Выбор профессионалов

Это не просто приложение, а визуальная среда программирования на нодах. Если вы хотите понять, как создавать видео в нейросетях на своем компьютере с полным контролем каждого пикселя, вам сюда.

ComfyUI

-

Суть: вы строите схему (workflow), соединяя блоки проводами. Можно комбинировать ControlNet, LoRA, апскейлеры и разные модели (например, Wan 2.1 или AnimatedDiff).

-

Плюсы: абсолютная гибкость, бесплатность (платите только за электричество), приватность.

-

Минусы: высокий порог входа. Нужно понимать, что такое сэмплер, VAE и латентное пространство.

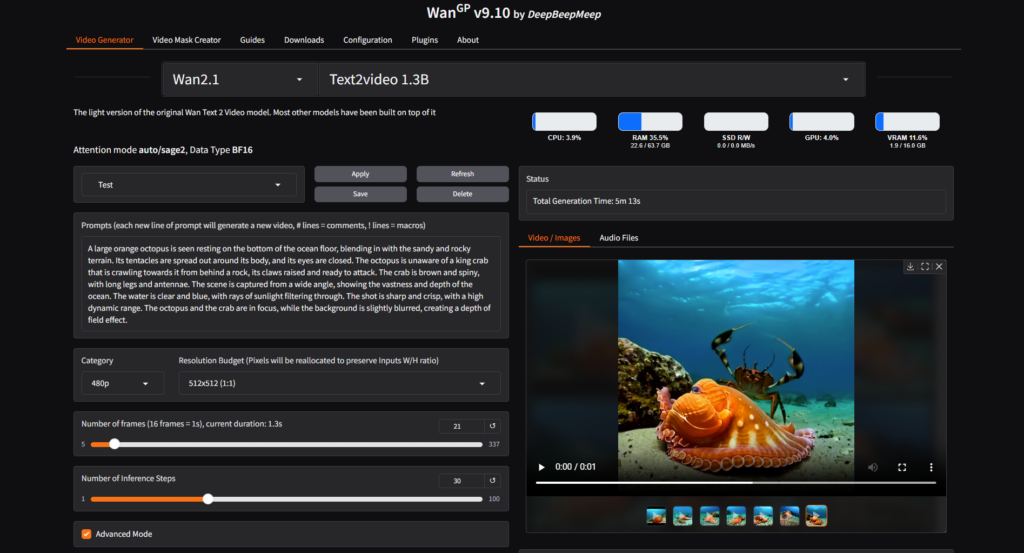

Приложение 2: Wan2GP / Portable Wan (Локально)

Если «лапша» из нодов в ComfyUI вас пугает, но мощная видеокарта простаивает, выбирайте портативные сборки под модели Wan.

Wan2GP

-

Суть: это первый создатель удобного локального веб-интерфейса для конкретных моделей. Скачали архив, распаковали, запустили run.bat.

-

Возможности: поддерживает установку соотношения стороны, смену FPS и разрешения. Отлично работает связка: сначала Low Noise для композиции, затем High Noise для детализации.

-

Совет: для экономии видеопамяти используйте квантованные версии моделей (GGUF/FP8).

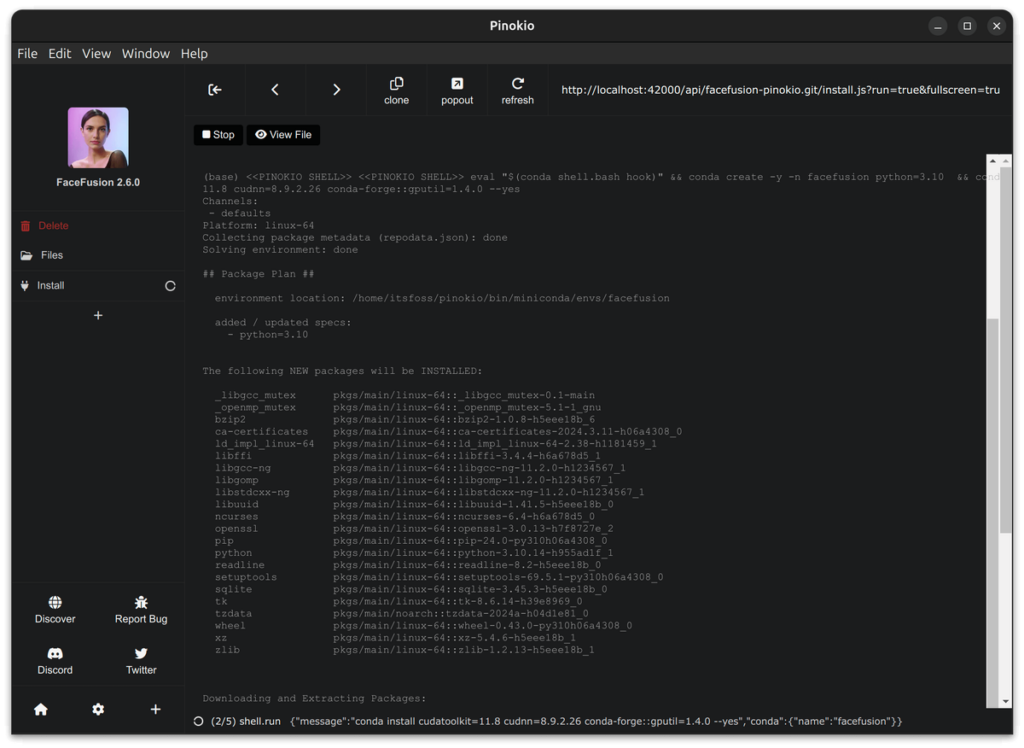

Приложение 3: Pinokio AI (Локальный лаунчер)

Браузер для нейросетей. Позволяет установить сложные скрипты в один клик.

Pinokio AI: лаунчер для нейросетей

-

Особенность: это GUI-оболочка. Через неё можно поставить и ComfyUI, и другие генераторы.

-

Нюанс: часто работает нестабильно и может качать гигабайты моделей в скрытые папки, забивая SSD. Используйте с осторожностью.

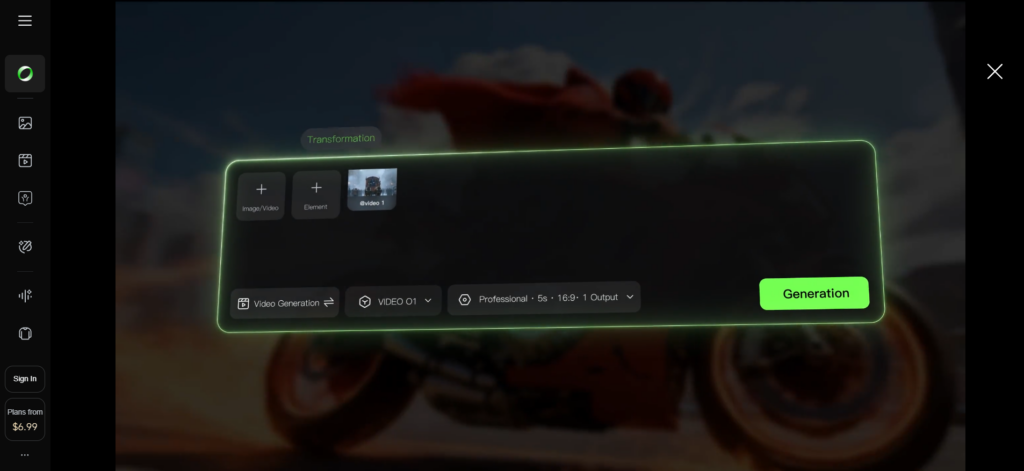

Приложение 4: Kling AI (Облако) — Китайский лидер

На данный момент это, пожалуй, самая мощная китайская нейросеть, доступная широкой публике.

Kling AI - король бюджетных генераций

-

Качество: Выдает фотореалистичный результат (до 1080p в Pro-версии). Kling ai отлично понимает физику тел и тканей.

-

Бесплатно: Дают около 66 кредитов ежедневно. Этого хватит на несколько тестов (примерно 6 видео). Есть водяной знак.

-

Сценарии: Text-to-Video и Image-to-Video.

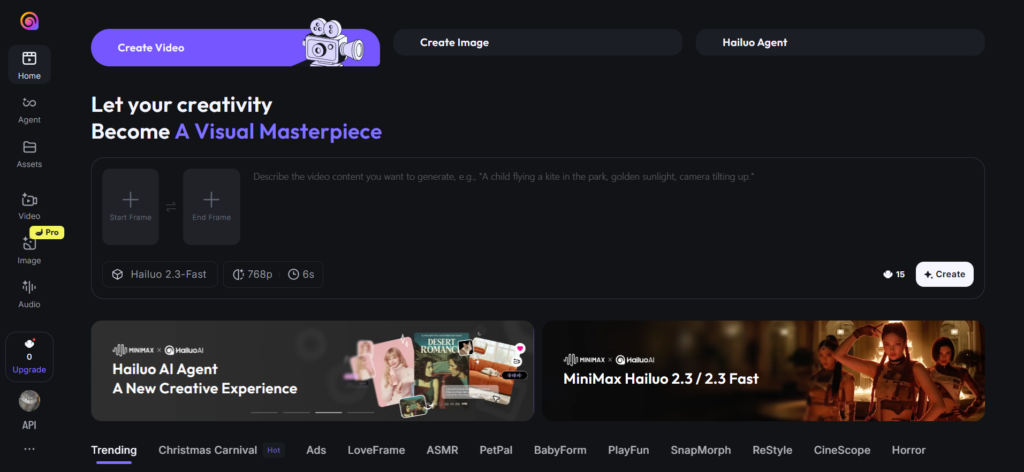

Приложение 5: Hailuo (MiniMax)

Еще один сильный игрок из Азии. Модель Hailuo-02 показывает потрясающую кинематографичность.

Hailuo

-

Фишка: Очень хорошо понимает текстовый описание на естественном языке.

-

Бонусы: При регистрации щедро насыпают кредитов, есть ежедневные пополнения. Видео генерируется быстро, но иногда серверы перегружены.

Дополнительные облачные сервисы

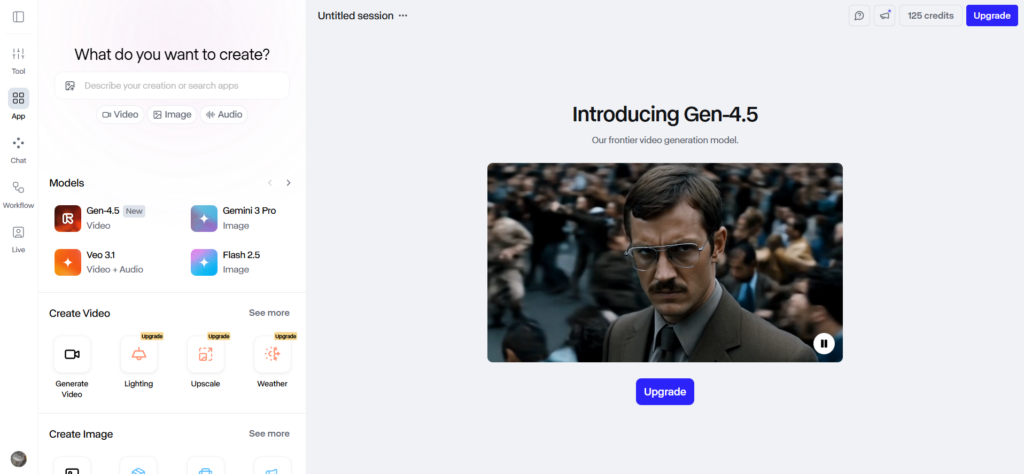

Runway Gen-4.5

Runway Gen-4.5

Ветеран рынка. Уникальная фишка — Motion Brush (кисть движения). Вы можете кистью выделить облака и сказать им «плыть влево». В бесплатной версии возможности сильно урезаны.

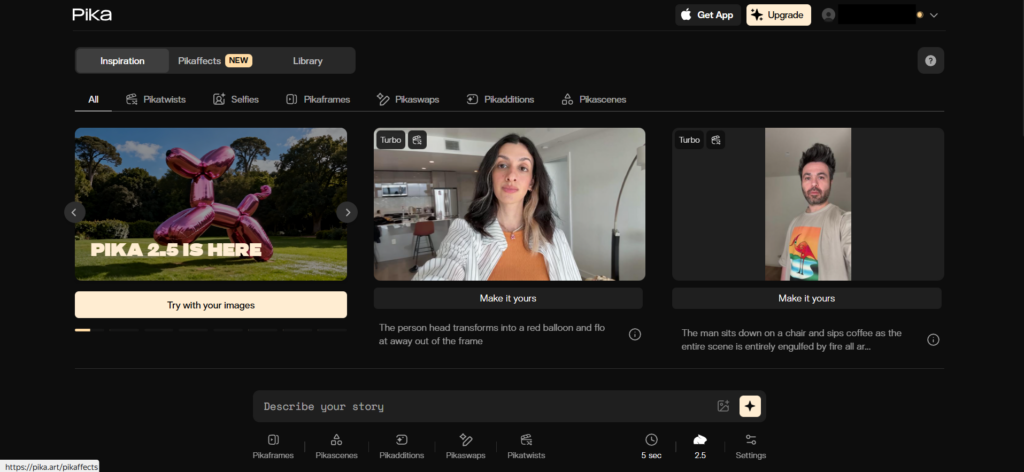

Pika (Pika Art)

Делает ставку на фановые эффекты. Умеет синхронизировать звук с движением губ (Lip Sync) и накладывать эффекты разрушения объектов.

Pika ART

Luma Dream Machine

Очень быстрая генерация (2-3 минуты). Хорошо держит геометрию объектов, они не «плывут» при повороте камеры.

Luma Dream Machine

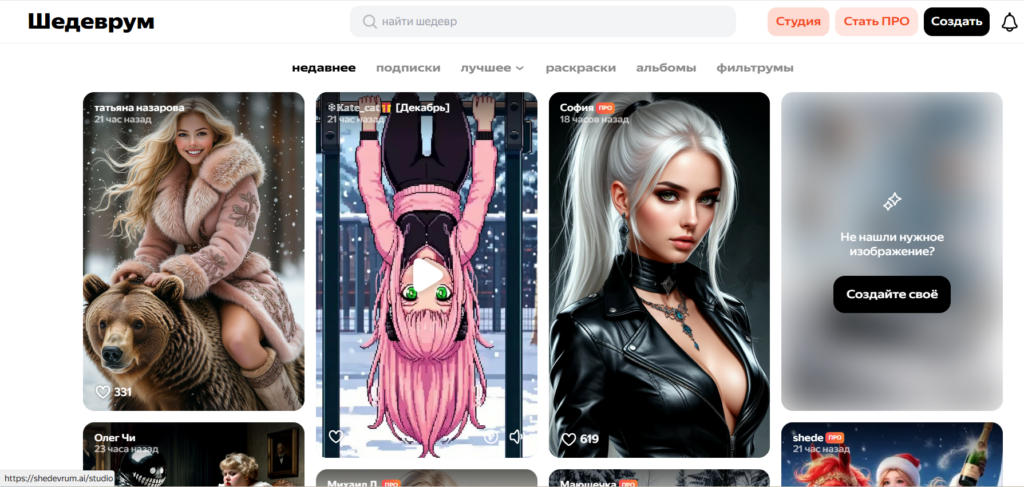

Kandinsky / Шедеврум

Отечественные решения. Шедеврум работает через мобильное приложение (бесплатно). Kandinsky доступен через GigaChat в Telegram, понимает русский язык.

Шедеврум

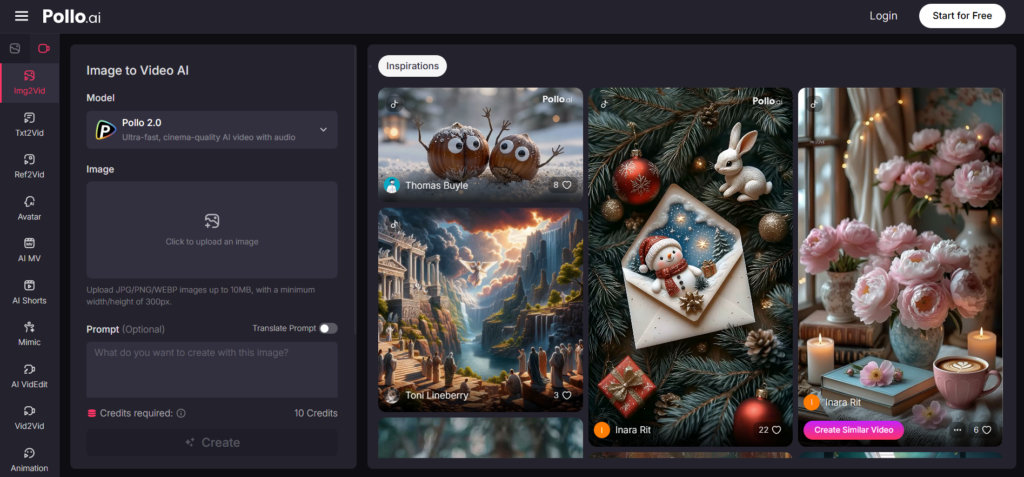

Pollo AI / Pixverse / Huge AI

Агрегаторы моделей. Удобны тем, что дают доступ к разным нейросетям в одном окне. Pixverse также предлагает функции апскейла до 4K.

Polo AI

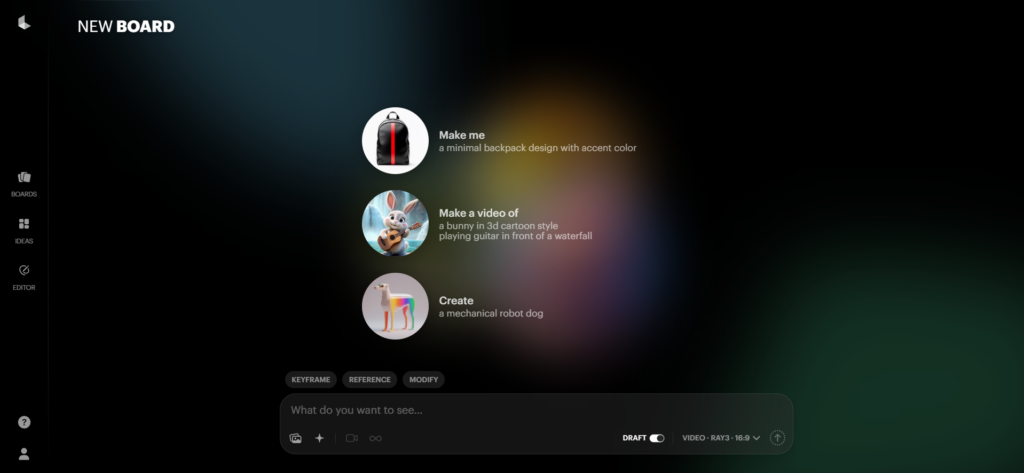

Google Veo / Sora

Титаны индустрии. Veo google доступен ограниченно (часто студентам), Sora — через закрытые тесты или ChatGPT Plus. Это эталон, но массовый доступ к нему сложен.

Google Veo

Как правильно создавать видео

Знать инструмент — полдела. Нужно уметь им пользоваться. Вот чек-лист, который поможет вам разобраться, как создать видео в нейросети бесплатно и качественно.

- Промпт — это кодНе пишите абстрактно «красивая девушка». Нейросети нужна конкретика.

-

Плохо: «Человек идет по улице».

-

Хорошо: «Кинематографичный кадр, вид снизу, киберпанк-улица, неоновые вывески, мужчина в кожаном плаще идет на камеру, дождь, отражения в лужах, 4k, высокая детализация».

-

Используйте теги стиля: photorealistic, anime style, 3d render, GoPro footage.

-

Промпт можно улучшать через ChatGPT, попросив его «расписать сцену для видео-нейросети».

-

Зафиксируйте референс (Image-to-Video)

Слабая сторона Text-to-Video — непредсказуемость. Лучше сначала сгенерируйте идеальную картинку в Midjourney или Flux, а потом загрузите её в Kling или Wan как первый кадр. Это гарантирует, что персонаж будет выглядеть так, как вы задумали. Загружать изображение — лучший способ контролировать композицию. -

Управляйте камеройБольшинство сервисов позволяют задать движение: Pan Right (панорама вправо), Zoom In (наезд), Tilt Up (наклон вверх). Статичная камера часто выдает артефакты, движение скрывает мелкие огрехи генерации.

-

FPS и плавность

Стандарт генерации — часто 16 или 24 кадра. Для большей плавности используйте инструменты интерполяции (например, RIFE или встроенные в Topaz Video AI), чтобы поднять фреймрейт до 60 FPS. -

Работа со звуком.

Добавлять звуковой ряд лучше на монтаже. Встроенные в нейросети звуковые эффекты пока примитивны. Используйте отдельные нейросети для звука (Suno, Udio) или библиотеки сэмплов. -

Негативный промпт

Если сервис позволяет, всегда прописывайте, чего быть не должно: morphing, extra limbs, blurry, text, watermark, distortion.

Что нужно для создания видео

Если вы решили, что можно создавать контент локально (что бесплатно и приватно), готовьтесь к апгрейду ПК. Видео — самый ресурсоемкий тип контента.

Системный блок с RTX

Минимальный набор (для экспериментов)

Вы сможете запускать легкие модели или ждать генерацию часами.

-

GPU (видеокарта): NVIDIA RTX 3060 (12 GB VRAM).

-

RAM (оперативная память): 32 GB DDR4.

-

CPU: Intel Core i5 / Ryzen 5 (последних поколений).

Важно: меньше 12 ГБ видеопамяти для видео — это боль.

Комфортный уровень (для работы)

Здесь вы сможете генерировать видео в приличном разрешении за разумное время.

-

GPU: NVIDIA RTX 4090 (24 GB VRAM) или RTX 3090. Объем памяти критичен для хранения весов модели и кэша кадров.

-

RAM: 64 GB DDR5. Модели часто выгружают данные в оперативку.

-

SSD: только быстрые NVMe M.2 (скорость чтения/записи 5000+ МБ/с). Загрузка моделей весом 20–40 ГБ требует скорости.

Облачный вариант (если ПК слабый)

Если у вас нет мощной видеокарты, ваш путь — облака.

-

Google Colab: можно арендовать GPU почасово.

-

Hugging Face Spaces: бесплатные демо-стенды, но с очередями. Видео можно делать прямо в браузере.

-

Подписки: Kling, Runway и прочие. Можно использовать их бесплатные ежедневные лимиты, комбинируя несколько сервисов.

Понимание того, как правильно создавать видео в нейросети, приходит с практикой. Начните с простых облачных решений, чтобы почувствовать вкус, а затем переходите к локальным инструментам для полного контроля.